Estreou ontem na Netflix o documentário Coded Bias (tradução livre: Viés codificado) e não tenho como enfatizar o suficiente que você deveria assistir.

O Fantasma da Ópera usava uma máscara para se esconder, enquanto Joy Buolamwini, pesquisadora do MIT Media Lab que é negra, usa uma máscara branca para ser vista. Nos dois casos, existe um lado ruim que explica a necessidade da máscara.

Se você nunca ouviu falar de machine learning e inteligência artificial, você precisa entender o seguinte sobre o assunto. O aprendizado de máquina é um sistema de notas que mede a probabilidade do que pode acontecer usando como histórico o que já aconteceu. Ou seja, alimenta-se de um banco de dados para determinar coisas como:

- Quem recebe taxa mais baixas para um financiamento imobiliário;

- Quem deve ou não ser contratado em uma empresa;

- Quem pode alugar uma residência;

- Quem pode abrir conta em um banco;

e etc…

“Machine Learning, ou aprendizado de máquina, é um código que aprende com as decisões do passado a prever o futuro.”

Muito perto do cenários outrora hipotéticos de Black Mirror, estamos vivendo em um mundo em que todos estão recebendo notas que já estão impactando a vida de todos nós, mesmo que a gente não queira.

Entre os vários exemplos onde as falhas dos algoritmos estão sendo expostas, o documentário aborda os casos em que:

- O algoritmo de contratação da Amazon que automaticamente desclassificou todas as mulheres do processo de seleção apenas pelo fato de serem mulheres;

- Do robô da Microsoft (Tay.ai) que teve que ser desligado 16 horas depois de ir ao ar por ter virado racista e misógino ao aprender com os comentários da internet;

- Do algoritmo de um sistema de saúde que priorizou pacientes brancos menos emergenciais, preterindo negros em quadro mais grave, indicando grave preconceito racial na decisão;

O mundo está virando uma grande base de dados e de notas. E um grande problema que temos é que, majoritariamente, os desenvolvedores de algoritmos são homens brancos que, propositalmente ou não, criam códigos enviesados olhando apenas um lado da história: o deles.

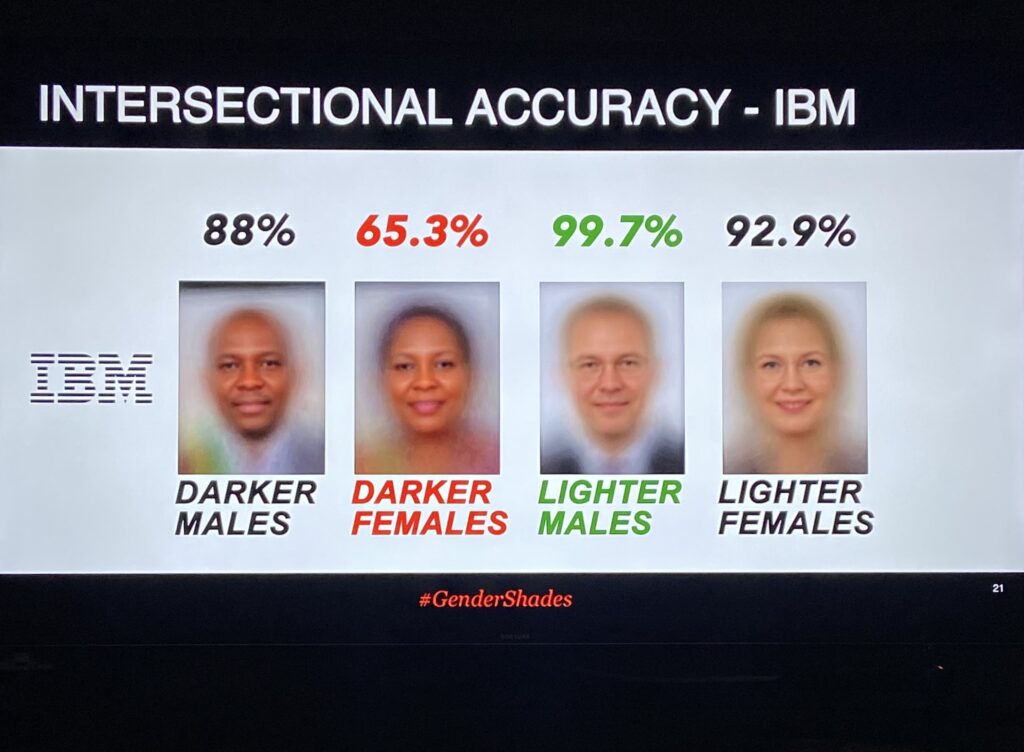

E as mulheres e os negros estão sendo prejudicados nesta equação. Os sistemas de reconhecimento facial existentes hoje apresentam taxas de acerto diferente a depender do gênero e da raça.

“Menos de 14% das pesquisadoras especialistas em A.I. são mulheres.”

Depois de criados, os algoritmos são caixas pretas que nem os desenvolvedores sabem indicar como os resultados foram gerados.

Se a gente não parar HOJE para refletir sobre essas regras, estaremos cada vez mais sendo avaliados por sistemas que não entendemos e que vão prejudicar os mais fracos da nossa sociedade. E o documentário vem para fazer essa provocação tão necessária para todos nós, independente da sua área de atuação profissional.

As decisões do passado estão carregadas de viés, preconceito e regras de poder. E são elas que estão definindo os códigos que vão impactar para sempre as nossas vidas. E enquanto as máquinas replicarem o mundo como ele é hoje, não vamos progredir socialmente.

Para assistir, é SÓ CLICAR NESTE LINK